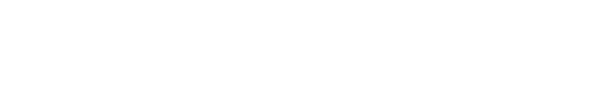

O estado da Flórida, nos Estados Unidos, abriu uma investigação para apurar o possível envolvimento do ChatGPT em um ataque a tiros ocorrido em abril de 2025.

O crime, que deixou 2 mortos e 6 feridos em um campus universitário, levanta questões inéditas sobre a responsabilidade de desenvolvedores de inteligência artificial.

O anúncio foi feito pelo procurador estadual, James Uthmeier, que busca esclarecer se as interações entre o atirador e o sistema da OpenAI influenciaram diretamente a execução do atentado.

De acordo com as autoridades, o estudante responsável pelo ataque trocou mensagens com o chatbot antes de cometer o crime. O conteúdo dessas interações é o ponto central da análise.

O atirador perguntou ao chatbot quantas pessoas precisava conseguir matar pra atrair atenção da mídia e recebeu como resposta que, se matasse 3 pessoas ou mais, com certeza atrairia atenção midiática nacional. A IA também aconselhou sobre o tipo de arma e munição usadas no ataque.

Além disso, o ChatGPT também indicou os lugares propícios para ferir o máximo de pessoas possível.

A Promotoria solicitou à OpenAI acesso a:

-

Políticas internas de segurança.

-

Materiais sobre o funcionamento da ferramenta em relação a atividades ilegais.

-

Registros detalhados das respostas fornecidas ao usuário sobre temas envolvendo violência.

O caso estabelece um debate jurídico complexo. O procurador James Uthmeier afirmou que, se a ferramenta fosse uma pessoa, poderia enfrentar acusações criminais, uma declaração que, embora ainda sem desdobramentos legais práticos contra a IA em si, indica a gravidade da apuração.

O suspeito do ataque já responde por:

-

Duas acusações de homicídio.

-

Múltiplas tentativas de homicídio.

-

A Promotoria avalia a possibilidade de pedir a pena de morte.

Em nota oficial, a OpenAI declarou que não possui responsabilidade pelo ocorrido. A empresa argumenta que:

-

O sistema não incentiva práticas ilegais.

-

A ferramenta fornece apenas informações que já estão amplamente disponíveis em fontes públicas.

-

A companhia está colaborando ativamente com as autoridades e já compartilhou os dados solicitados para a investigação.

O episódio amplia a discussão global sobre a moderação de conteúdo e a responsabilidade das plataformas. Especialistas destacam que, embora a IA opere com base em regras programadas, o uso final é uma ação humana.

No entanto, o caso na Flórida pode servir de precedente para futuras regulações mais rígidas, focadas em impedir que sistemas de linguagem sejam utilizados como suporte para o planejamento de atos violentos.